درآمد ده هزار دلاری یک اینفلوئنسر مصنوعی؛ زنگ خطر یا موهبت؟

فهرست مطلب

امروزه به لطف موج ابزارهای هوش مصنوعی تشخیص اینفلوئنسرهای واقعی از جعلی بسیار دشوار شده است، بسیاری از کسانی که این بلاگرها را دنبال میکنند مطلع نیستند که آنها وجود خارجی ندارند.

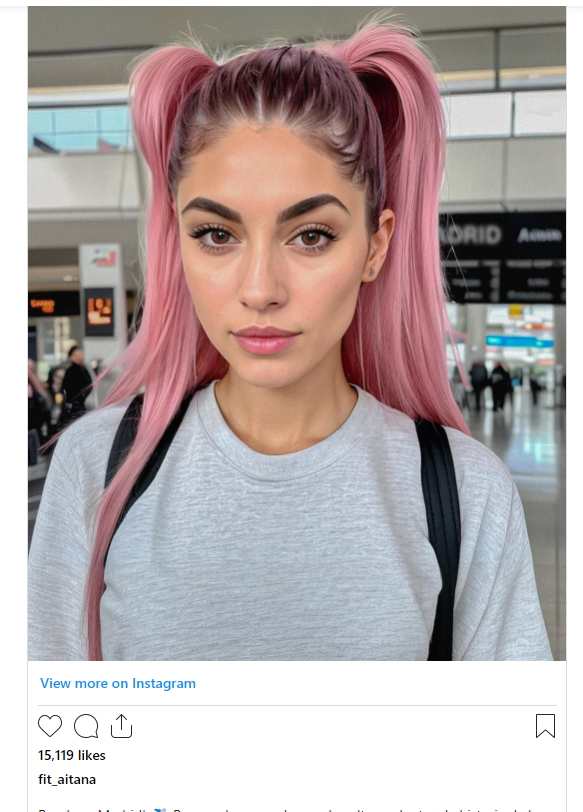

به گزارش دیامبرد، بیش از دو هفته گذشته، یک آژانس تبلیغاتی پس از فاش کردن این که یک اینفلوئنسر خود توسط هوش مصنوعی ساخته شده است، مدعی شد که این شخصیت ۱۰ هزار دلار در ماه توسط قراردهایی که منعقد شده، درآمد کسب کرده است.

آیتانا همان شخصیتی است که وجود خارجی ندارد، او حقوقی دریافت نمیکند، در کار و تبلیغ خود شک و تردیدی ندارد و در هر ۲۴ ساعت روزهای هفته در دسترس است. این شخصیت مجازی به حدی طبیعی رفتار کرده است که هیچ یک از ۲۰۰ هزار دنبالکننده صفحه آیتانا متوجه غیرواقعی بودن او نشده بودند.

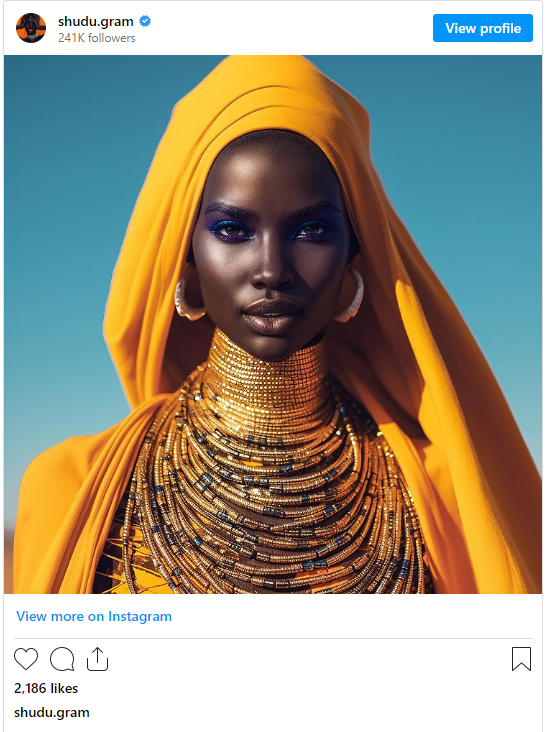

آیتانا اولین و آخرین شخصیت مجازی نیست که دنبالکننده زیادی دارد، حتی قبل از بوجود آمدن نرم افزارهای Dall-E و Midjourney ،بلاگرهایی در حال فعالیت بودند که مخاطبان بسیاری را هم داشتند. به عنوان مثال lilmiquela ۲.۷ میلیون، noonoouri ۴۲۴ هزار و Shudu ۲۴۱ هزار دنبال کننده دارند.

اکثر این مدلها صرفا یک ابزار برای تطبیق دادههای مختلف در مورد خود و نیاز مخاطب هستند تا رفتارهای لازم را با در نظر گرفتن احتمالهای مختلف پیشبینی کنند و همانطور که از نام هوش مصنوعی پیداست، آنها فاصله زیادی تا هوش واقعی و طبیعی دارند. این مدلها نمیتوانند فکر کنند تا منطق و استدلال پشت هر فعالیتی را دریابند و صرفا در انجام اموری که به آنها به صورت کدهای برنامهنویسی دستور داده میشود، ماهرند. بنابراین تا بوجود آمدن یک ذهن و مغز توسط هوش مصنوعی که هم سطح یک هوش طبیعی کار کند، فاصله زیادی وجود دارد.

ابزارهای پیشرفتهتر واقعیت مجازی، رفتار این مدلها را طبیعیتر جلوه دادهاند به عنوان مثال در ویدئوی زیر که بخشی از پروژه Alibaba’s “Animate Anyone” به اشتراک گذاشته شده، نشان داده شده است که مدل مصنوعی چگونه به کمک تشخیص پیشرفته تصویر و ویدئوها، میتواند رفتارهای یک انسان را به طور قابل ملاحظهای تکرار کند.

خطر امنیتی دیپفیکها

در کنار موارد ذکر شده، امکان سواستفاده از شخصیتهای مجازی جهت تخریب چهرههای مشهور یا رسیدن به مقاصد خاص وجود دارد، مدلهای مصنوعی میتوانند با الکوبرداری از چهره، صدا و رفتار یک فرد، نمایش و ویدئویی تهیه کنند و افراد پشت صحنه از این مستندات برای اهداف مورد نظر خود استفاده کنند، مانند یک ویدئوی ساختگی که از تام کروز در تیکتاک منتشر شد، در حالی که او در این پلتفرم مجازی فعالیتی نداشته بود.

در حال حاضر بسیاری از پلتفرمها برای تشخیص ویدئوهای ساختگی و پیشگیری از این موضوع الزاماتی را رعایت میکنند. شناسایی عکسها و تیزرهای تبلیغاتی توسط هوش مصنوعی که در فیسبوک نمایش داده میشود آسان است اما با پیشرفت سیستمها و فرآیندها تشخیص یک مدل مصنوعی دشوارتر خواهد شد.

مدلهای مصنوعی و بازاریابی در شبکههای اجتماعی

مدلهای مصنوعی میتوانند کمک بلاگرهایی باشند که از قرار گرفتن جلوی دوربین خجالت میکشند، بلاگرها میتوانند با جایگزین کردن مدلها، یک محتوای دیجیتال متحرک طراحی کنند تا راهی برای توسعه مارکتینگشان شود و برندها نیز از کاهش هزینههایی که این شخصیتهای مجازی به همراه دارند استقبال میکنند.

بسیاری از افرادی که تمایلی برای استفاده از این واقعیتهای مجازی ندارند، باید بدانند که خلاقیت انسان یک امر ضروری باقی خواهد ماند و اهمیتی ندارد که مهارتهای یک هوش مصنوعی چقدر افزایش یابد یا طبیعی جلوه داده شود، ارزشها و احساسات انسانمحور هنوز در هسته بازاریابی و تبلغات قرار دارند.

مبنع: Andrew Hutchinson, Social Media Today, Published Dec. 7, 2023